Anthropic представила Claude Opus 4.7 для продвинутой разработки

OpenAI обновила Codex и выпустила «рассуждающую» ИИ-модель GPT-Rosalind

Компания Anthropic представила Claude Opus 4.7 — самую сильную на сегодня модель Opus.

Introducing Claude Opus 4.7, our most capable Opus model yet.

— Claude (@claudeai) April 16, 2026

It handles long-running tasks with more rigor, follows instructions more precisely, and verifies its own outputs before reporting back.

You can hand off your hardest work with less supervision. pic.twitter.com/PtlRdpQcG5

Новая версия открыта для всех платных пользователей Claude и в API — $5 за 1 млн входных токенов, $25 — за 1 млн выходных.

Ключевые улучшения

Opus 4.7 лучше всего показывает себя на сложных задачах. Пользователи доверяют ей то, что раньше требовало пристального контроля, заявили разработчики.

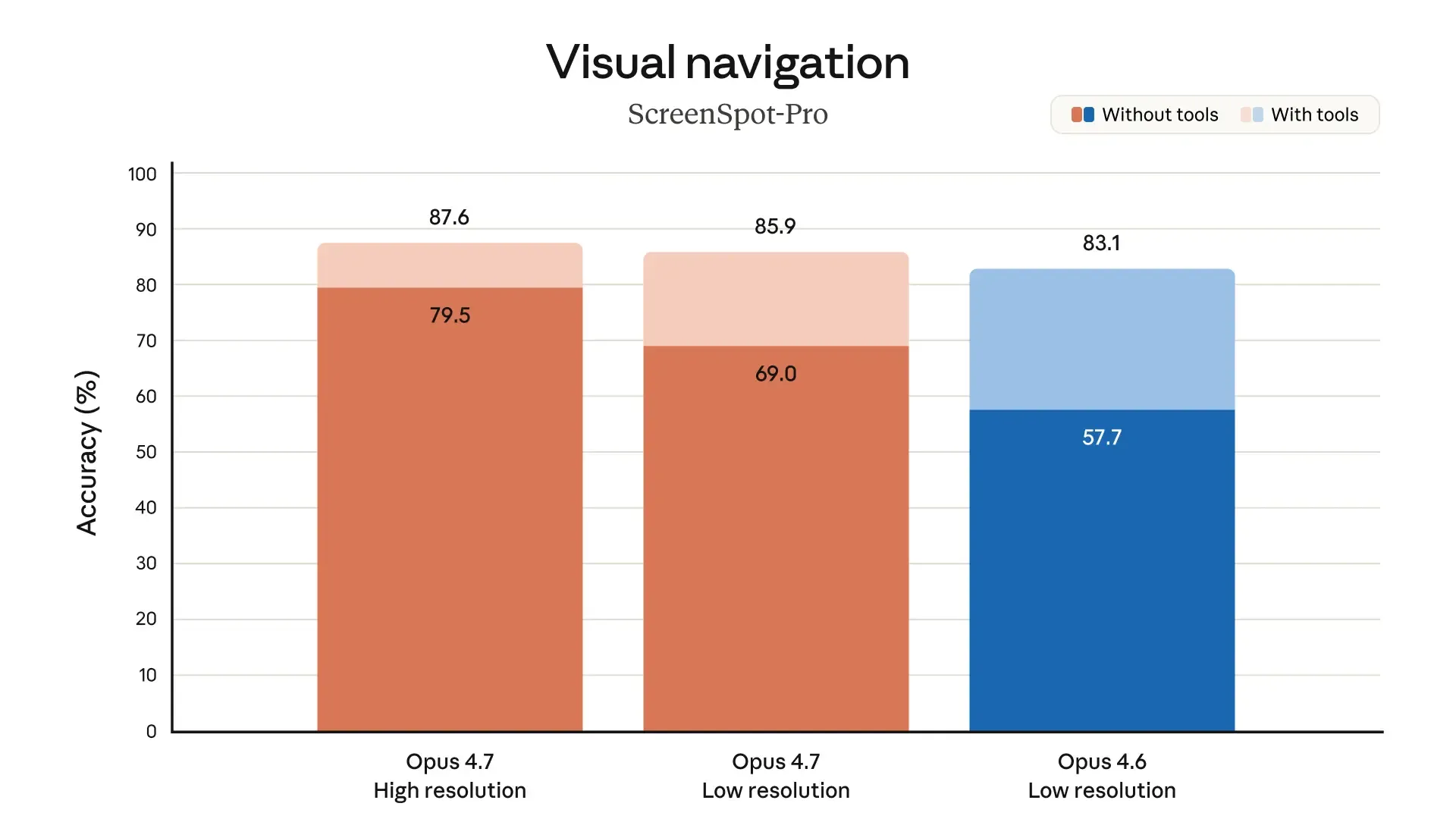

В агентном программировании модель обошла предшественницу на 10%, в обработке визуальных данных — на 13%. По остальным параметрам прирост оказался скромнее.

Модель получила значительно расширенные визуальные возможности: она обрабатывает изображения до 2576 пикселей по длинной стороне (около 3,75 мегапикселей) — более чем в три раза больше предыдущих версий Claude.

Opus 4.7 точнее следует инструкциям. Написанные для старых моделей промпты могут давать неожиданные результаты: они интерпретировали инструкции свободно, а новая версия воспринимает их буквально. Рекомендуется перенастроить запросы.

Кроме того, последняя Claude научилась запоминать информацию между сессиями — она сохраняет заметки в файлы и может использовать их при каждом новом разговоре.

Anthropic добавила в Opus 4.7 новый уровень усилий xhigh («экстра высокий») — между high («высокий») и max («максимальный»). Он позволяет точнее настраивать баланс между глубиной анализа и скоростью отклика.

В Claude Code для всех планов уровень усилий по умолчанию повышен до xhigh.

Другие нововведения включают:

- Task budgets (публичная бета API) — управление расходом токенов;

- /ultrareview — выделенная сессия проверки кода в Claude Code;

- режим auto для Max-пользователей — Claude принимает решения сам.

Ограничение кибервозможностей

Opus 4.7 слабее Mythos Preview в кибербезопасности. Anthropic целенаправленно снижала эти возможности при обучении. Модель имеет встроенную защиту, блокирующую запрещенные и высокорисковые запросы.

«То, что мы узнаем из реального развертывания этих защитных механизмов, поможет нам продвигаться к нашей конечной цели — широкому выпуску моделей класса Mythos», — отметила команда стартапа.

Специалистам по безопасности, которые хотят использовать Opus 4.7 в законных целях (исследование уязвимостей, пентесты), в Anthropic предложили присоединиться к новой программе Cyber Verification.

Для пользователей ограничения стали проблемой. Некоторые клиенты жалуются, что модель отказывается писать код, поскольку «усматривает вредоносное ПО в каждом запросе».

It suspects everything is malware, and still refuses to code after confirming that there is no malware pic.twitter.com/YXpaoNV8YG

— Hanh Nguyen (@fashiongiik) April 16, 2026

Ответ OpenAI

Компания OpenAI представила «крупное обновление» Codex, которое пока доступно только на macOS.

Codex for (almost) everything.

— OpenAI (@OpenAI) April 16, 2026

It can now use apps on your Mac, connect to more of your tools, create images, learn from previous actions, remember how you like to work, and take on ongoing and repeatable tasks. pic.twitter.com/UEEsYBDYfo

Новая версия может взаимодействовать с приложениями на компьютере пользователя: видеть экран, кликать и печатать собственным курсором. На Mac поддерживается параллельная работа нескольких агентов без помех для другого софта.

Встроенный браузер, плагины и жизненный цикл разработки

Codex оснащен встроенным браузером: страницы можно комментировать напрямую, давая агенту точные указания. Это может быть полезно для фронтенд- и игровой разработки.

With computer use on macOS, Codex can now use any app by seeing, clicking, and typing with its own cursor.

— OpenAI (@OpenAI) April 16, 2026

It runs in the background without taking over your computer, working on tasks like frontend iteration, app testing, or any workflow that doesn't expose an API. pic.twitter.com/iO9iubLZX9

Разработчики планируют расширить функционал для управления браузером за пределами локального окружения.

Также Codex получил поддержку gpt-image-1.5 для генерации и итераций изображений. Вместе со скриншотами и кодом это позволяет создавать визуальные концепты, фронтенд-дизайн, макеты и игры в едином интерфейсе.

You can now generate and iterate on images with gpt-image-1.5 in Codex to create frontend designs, mockups, game assets, and more without leaving your workflow.

— OpenAI (@OpenAI) April 16, 2026

Usage is included with your ChatGPT account, no API key needed. pic.twitter.com/ay17I3Nxoa

OpenAI выпустила более 90 дополнительных плагинов, объединяющих навыки, интеграции с приложениями и MCP-серверы. Среди них — Atlassian Rovo для работы с JIRA, CircleCI, CodeRabbit, GitLab Issues, Microsoft Suite, Neon by Databricks, Remotion, Render и Superpowers.

В Codex добавили поддержку комментариев GitHub, нескольких вкладок терминала и подключение к удаленным devbox через SSH (в альфа-версии).

Пользователи могут открывать файлы прямо в боковой панели с расширенным предпросмотром PDF, таблиц, слайдов и документов, а также использовать новую панель сводки для отслеживания планов агента, источников и артефактов.

Память и планирование

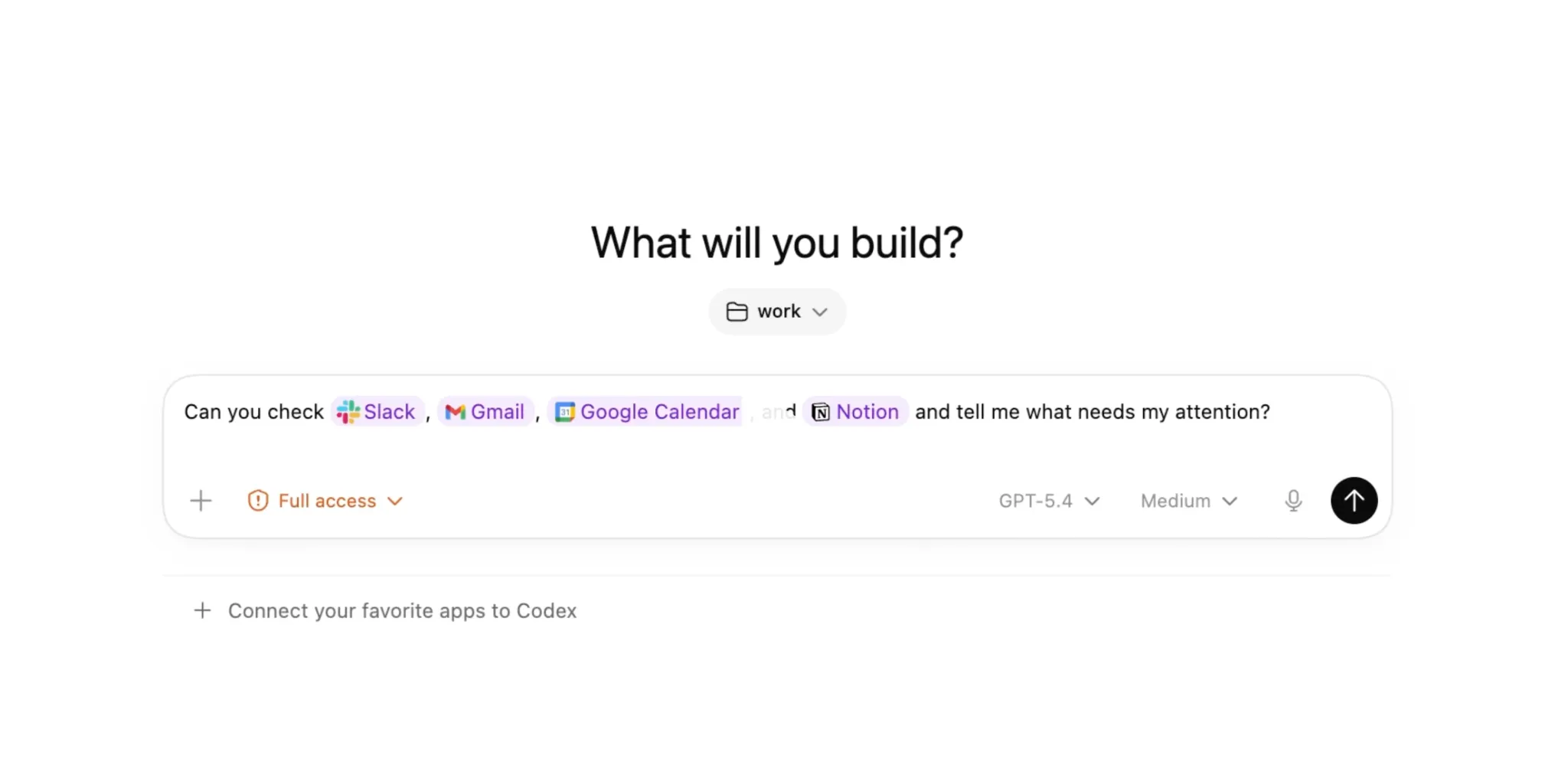

Codex получил возможность планировать будущую работу и автоматически возобновлять выполнение долгосрочных задач — потенциально на дни или недели. Команды используют автоматизацию для разных целей: от запросов на проверку кода до отслеживания задач в Slack, Gmail и Notion.

Разработчики улучшили память помощника. Codex научился запоминать полезный контекст из прошлых диалогов — личные предпочтения и исправления.

Модель также активно предлагает полезные действия, продолжая работу с того места, где остановился пользователь. Например, агент может найти открытые комментарии в Google Docs, извлечь контекст из Slack, Notion и кодовой базы, а затем выдать приоритетный список действий.

Новая модель GPT

Дополнительно OpenAI представила «рассуждающую» ИИ-модель GPT-Rosalind для ускорения разработки лекарств.

Introducing GPT-Rosalind, our frontier reasoning model built to support research across biology, drug discovery, and translational medicine. pic.twitter.com/PubLU0FkSv

— OpenAI (@OpenAI) April 16, 2026

Она названа в честь английского биофизика Розалинд Франклин, чьи исследования помогли раскрыть структуру ДНК и заложили основы современной молекулярной биологии.

Разработчики отметили, что в США на разработку нового лекарства уходит в среднем 10-15 лет. Будущее препарата во многом определяется на начальных стадиях исследований. Наибольшие трудности связаны с анализом огромных массивов научных публикаций и узкоспециализированных баз данных.

Задача GPT-Rosalind — служить ассистентом биолога: суммировать научные тексты, формулировать гипотезы, выстраивать планы экспериментов и обрабатывать информацию. Модель особенно сильна в задачах, связанных с белками, молекулами, генами и аналогичными биологическими структурами.

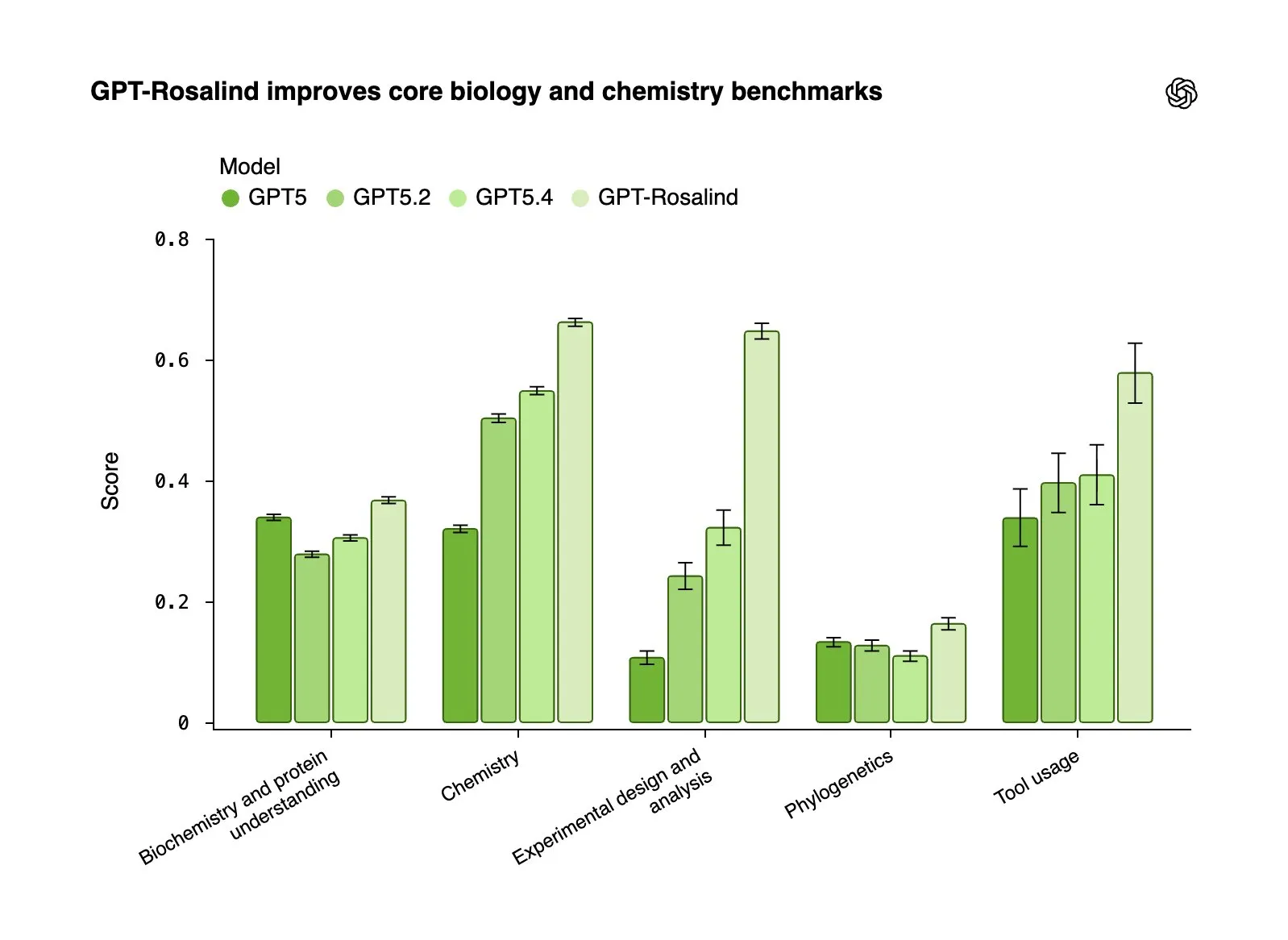

На бенчмарке BixBench (реальный биоинформатический анализ) GPT‑Rosalind показала один из лучших результатов среди моделей с опубликованными данными.

На LABBench2 решение обошло GPT‑5.4 в шести из 11 задач. Самый заметный отрыв — в CloningQA, где требуется проектировать ДНК и ферменты для протоколов молекулярного клонирования.

Дополнительно OpenAI опубликовала бесплатный плагин Life Sciences для Codex на GitHub. Он доступен всем пользователям и позволяет подключать ИИ к более чем 50 публичным научным базам данных и профильным инструментам.

Напомним, 16 апреля компания Google выпустила Gemini 3.1 Flash TTS — обновленную модель синтеза речи на базе поколения Gemini 3.

Рассылки ForkLog: держите руку на пульсе биткоин-индустрии!